Die Gebärdensprache - eine besondere Form der Kommunikation

Die Gebärdensprache verwendet manuelle (Hände und Arme) und nichtmanuelle (Kopf und Oberkörper) Ausdrucksmittel. Es gibt unterschiedliche Bedeutungen der Gebärden in den verschiedenen Kulturen. Das Fingeralphabet dient als Ergänzung für Begriffe, die sich nicht mit der Gebärdensprache darstellen lassen.

Die Ausdrucksmittel der Gebärdensprache

Die Gebärdensprache verwendet andere Ausdrucksmittel, als die gesprochene Sprache. Während wir die gesprochene Sprache vor allem akustisch wahrnehmen, verwendet die Gebärdensprache manuelle und nicht manuelle Ausdrucksmittel. Zu den manuellen Ausdrucksmitteln zählen Hände und Arme, zu den nichtmanuellen Ausdrucksmitteln zählen der Gesichtsausdruck, der Blick, der Kopf, der Oberkörper und das Mundbild (vgl. Boyes Braem, 1990, S. 17).

Wenn man sich die Gebärdensprache vorstellt, denken wahrscheinlich viele sofort an die Hände, jedoch sind vor allem die nichtmanuellen Ausdrucksmittel zur Vermittlung von Gefühlen und der Grammatik zuständig (vgl. Boyes Braem, 1990, S. 18).

Interkultureller Unterschied von Gebärden

Mit der folgenden Kurzgeschichte sollte gezeigt werden, dass Gebärden eine unterschiedliche Bedeutung in den verschiedenen Regionen der Welt haben.

Ein Gebärdender aus China trifft auf einen Gruppe von amerikanischen Menschen, die ebenfalls mit Hilfe der Gebärdensprache sprechen. Er bezieht sich auf sich selbst, indem er mit dem Zeigefinger seine Nasenspitze berührt. Die anderen sind sehr überrascht und verwirrt. Einer fragt ihn: Warum denn die Nase?, weil für ihn bedeutet das komisch, hässlich oder langweilig. Er würde sich selbst nie so bezeichnen und zeigt ihm, wie er sich ausdrücken würde und berührte sein Brustbein mit dem rechten Zeigefinger. Daraufhin war der Chinese verwirrt, weil für ihn das Hass, Ekel oder Übelkeit bedeutet (vgl. Boyes Braem, 1990, S. 124).

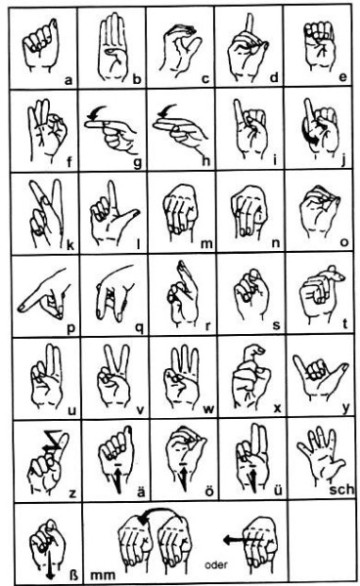

Das Fingeralphabet

Das

internationale Fingeralphabet wird vor allem für Begriffe, für die es

keine Gebärden gibt, verwendet. Es wird zur Buchstabierung von

Eigennamen von Personen, technischen Begriffen, Städten, sowie

Organisationen verwendet. Das Fingeralphabet besteht aus verschiedenen

Handformen, die die Buchstaben des Alphabets abbilden. Mithilfe dieses

Alphabets können Wörter in der Luft buchstabiert werden, wenn kein

Papier und kein Stift zur Verfügung ist. Der Unterschied zwischen dem

Fingeralphabet und der Gebärdensprache liegt darin, dass bei der

Gebärdensprache eine einzelne Bewegung einem Wort entspricht, während

beim Fingeralphabet das Wort buchstabiert wird. Es sollte versucht

werden, so gut wie möglich, immer an der gleichen Stelle, wie zum

Beispiel vor der Brust und immer mit derselben Handstellung buchstabiert

zu werden. Es sollte so wenig wie möglich an Bewegungen durchgeführt

werden. Das heißt, die Hand nur dann bewegt, wenn von einem zum nächsten

Buchstaben gewechselt wird (vgl. Boyes Braem, 1990, S. 146).

Das

internationale Fingeralphabet wird vor allem für Begriffe, für die es

keine Gebärden gibt, verwendet. Es wird zur Buchstabierung von

Eigennamen von Personen, technischen Begriffen, Städten, sowie

Organisationen verwendet. Das Fingeralphabet besteht aus verschiedenen

Handformen, die die Buchstaben des Alphabets abbilden. Mithilfe dieses

Alphabets können Wörter in der Luft buchstabiert werden, wenn kein

Papier und kein Stift zur Verfügung ist. Der Unterschied zwischen dem

Fingeralphabet und der Gebärdensprache liegt darin, dass bei der

Gebärdensprache eine einzelne Bewegung einem Wort entspricht, während

beim Fingeralphabet das Wort buchstabiert wird. Es sollte versucht

werden, so gut wie möglich, immer an der gleichen Stelle, wie zum

Beispiel vor der Brust und immer mit derselben Handstellung buchstabiert

zu werden. Es sollte so wenig wie möglich an Bewegungen durchgeführt

werden. Das heißt, die Hand nur dann bewegt, wenn von einem zum nächsten

Buchstaben gewechselt wird (vgl. Boyes Braem, 1990, S. 146).

Außerdem können nicht nur einzelne Wörter, sondern auch ganze Sätze mit dem Fingeralphabet geschrieben werden. Die Wortfolge entspricht den grammatikalischen Regeln der gesprochenen Sprache. Dies ist nicht so üblich. Menschen, die mit der Gebärdensprache kommunizieren, verwenden eine eigene Grammatik und Satzstellung. Jedoch hat sich gezeigt, dass nur 56% der mit den Fingern buchstabierten Wörter im Satz verständlich sind. Des Weiteren ist eine Kommunikation mit diesem Alphabet über einen längeren Zeitraum anstrengend und ermüdend. Um Missverständnisse zwischen den verschiedenen Kulturen auszuschließen, wie wir es bereits erwähnt haben, findet das Fingeralphabet zwischen Gehörlosen aus verschiedenen Ländern eine breite Anwendung. Diese können jedoch voneinander abweichen. Beim britischen Alphabet werden beispielsweise beide Hände verwendet (vgl. Boyes Braem, 1990, S. 146f).

Cochlea-Implantate und Gebärdensprache

Häufig wird geraten, bei Kindern mit Cochlea-Implantat auf Gesten nicht zu reagieren, sondern darauf zu beharren, dass das Kind lautsprachlich äußert, was es sagen will. Wenn aber auf eine Geste nicht reagiert wird, verweigert man die Reaktion auf ein Kommunikationsangebot, d. h., das Kind versteht dies als Ablehnung und wird seine Kommunikation und somit auch seine Lernprozesse einschränken. Gisela Szagun (2012) rät aber nach langjährigen Forschungsarbeite, die gestische Aussage des Kindes in Worten wiederzugeben und mit Worten gestisch unterstützt zu beantworten. Ist ein Kind hörgeschädigt und kann trotz Cochlea-Implantats nicht genügend hören, sollte es als Alternative oder zusätzlich Gebärdensprache lernen, denn der Aufbau eines funktionsfähigen Symbolsystems ist unabhängig davon, ob es lautlich oder gebärdet gelingt. Bisher hat man immer befürchtet, dass die Kommunikation mit Gebärden den Erwerb der Lautsprache beeinträchtiget, doch lässt sich dies Hypothese durch empirische Fakten nicht stützen, vielmehr kann es nachteilig sein, Kindern mit Hörbeeinträchtigung visuell übermittelte Informationen vorzuenthalten. Das liegt daran, dass eine lautsprachliche Unterhaltung in mehr oder weniger starkem Maße durch Gesten begleitet wird. Auch schauen Menschen sich an und nehmen damit Mundbewegungen beim Sprechen wahr, auch wenn das nicht bewusst geschieht. Das alles hilft Menschen bei der Übermittlung der sprachlichen Mitteilung, wobei es auch Normalhörigen beim Spracherwerb hilft. Daher sollte die visuelle Information - sei es in Form eines Mundbildes beim Sprechen oder in Form von Gesten und Gebärden - Kindern mit Cochlea Implantat nicht vorenthalten werden soll, denn es würde den Spracherwerb für sie gegenüber normalhörigen Kindern erschweren. Indem Kinder die Bewegungen, wenn auch verdeckt, mitmachen, lernen sie den Laut, denn die Muskelbewegungen geben dem Gehirn Informationen über die Lautbildung. Diese kinästhetische Information wird zusammen mit der lautlichen Information vom Gehirn gespeichert und die Bildung des Lautes allmählich gelernt. In der kindlichen Entwicklung ist es beim Lernen hilfreich, Informationen von Sinneseindrücken und durch Bewegung zu haben, sodass es daher ausgesprochen hilfreich ist, wenn sich Kinder beim Spracherwerb zusätzlich am Mundbild orientieren

Das Broca-Areal als Zentrale auch bei Gebärdensprache

Die kognitionswissenschaftliche Forschung zu Gebärdensprachen seit den 60er Jahren zeigte, dass Gebärdensprachen vollwertige autonome Sprachen darstellen und über eine komplexe Organisation auf mehreren sprachlichen Ebenen wie Grammatik und Bedeutung verfügen. Studien zur Verarbeitung von Gebärdensprache im menschlichen Gehirn hatten bereits einige Ähnlichkeiten aber auch Unterschiede zwischen Gebärden- und Lautsprachen gefunden, doch ist es schwierig, daraus ein einheitliches Bild über die Verarbeitung beider Formen von Sprache im Gehirn abzuleiten.Über siebzig Millionen gehörlose Menschen weltweit verwenden eine der mehr als zweihundert Gebärdensprachen, und obwohl diese im Gehirn auf ähnliche Strukturen wie Lautsprachen zugreifen, konnte man bisher noch nicht jene Hirnregionen identifizieren, die beide Sprachformen nutzen. Man wusste also bisher nicht, welche Hirnregionen tatsächlich in die Verarbeitung von Gebärdensprache involviert sind bzw. wie groß dabei die Überschneidung mit Hirnregionen ist, die Hörende für die Lautsprachverarbeitung nutzen.

Trettenbrein et al. (2020) haben jüngst bei einer Metaanalyse entdeckt, dass offensichtlich das Broca-Areal in der linken Gehirnhälfte der zentrale Knotenpunkt sowohl in gebärdeter als auch gesprochener Form darstellt, womit sich zeigt, dass das Gehirn generell darauf ausgerichtet ist, Grammatik und Bedeutung von Sprache zu verarbeiten, gleichgültig, ob sie gehört oder oder gesehen wird. Dabei konnte man erstmals statistisch robust die Areale identifizieren, die über alle Studien hinweg an der Verarbeitung von Gebärdensprache beteiligt sind. Dabei war das Broca-Areal im Stirnhirn der linken Hirnhälfte eine der Regionen ist, bei der Verarbeitung von Gebärdensprache in fast jeder der ausgewerteten Studien involviert, wobei dieses Areal eine zentrale Rolle in der Lautsprache spielt und dort etwa für die Grammatik und Bedeutung zum Einsatz kommt. Auch konnte man zeigen, welche Rolle das rechte Stirnhirn, das Pendant zum Broca-Areal auf der linken Seite, spielt, denn dieses trat in vielen der ausgewerteten Studien zur Gebärdensprache ebenfalls immer wieder auf, weil es nicht-sprachliche Aspekte wie räumliche oder soziale Informationen des Gegenübers verarbeitet. Das bedeutet, dass Bewegungen von Händen, Gesicht und Körper, aus denen ja Gebärden bestehen, Gehörlose und Hörende prinzipiell ähnlich wahrnehmen, doch nur bei Gehörlosen aktivieren sie zusätzlich das Sprachnetzwerk in der linken Hirnhälfte, inklusive des Broca-Areals.

Gehörlose nehmen Gesten demnach als Gebärden mit sprachlichem Inhalt wahr statt als pure Bewegungsabläufe, wie es bei Hörenden der Fall ist. Man schließt nun auch daraus, dass das Gehirn auf Sprache an sich spezialisiert ist, jedoch nicht auf das Sprechen

Literatur

Boyes Braem, P. (1990). Einführung in die Gebärdensprache und ihre Erforschung. Hamburg: Verlag Signum.

Donath, P., Hase, U., Prillwitz, S. & Wempe, K. (1996). Eine Minderheit verschafft sich Gehör. Hamburg: Verlag Signum.

Szagun, Gisela (2012). Wege zur Sprache - Ratgeber zum Spracherwerb bei Kindern mit Cochlea-Implantat. Pabst.

Trettenbrein, P. C., Papitto, G., Friederici, A. D., & Zaccarella,

E. (2020). The functional neuroanatomy of language without speech: An

ALE meta-analysis of sign language. Human Brain Mapping, 42, 699712.

Überblick: Was ist nonverbale Kommunikation?

Überblick: Was ist nonverbale Kommunikation?

Waren diese Informationen für Sie nützlich? Dann klicken Sie bitte auf das